AI-agenter bevæger sig hurtigt fra imponerende demoer til egentlige værktøjer, der kan handle på dine vegne, og OpenClaw er et af navnene, der har sat gang i den nyeste bølge af opmærksomhed. Du har måske også hørt softwaren omtalt som Clawdbot eller Moltbot — navne, der blev brugt i forskellige udviklingsstadier af skaberen, den østrigske udvikler Peter Steinberger.

Markedsført som en fuldautomatisk personlig assistent, der kan betjene software for dig, rejser den samtidig vigtige spørgsmål om adgang og sikkerhed.

- AI-agenter er handlingsdygtige AI-systemer, ikke kun samtaleværktøjer.

- Værktøjer som OpenClaw viser, hvor kraftfulde selvhostede AI-agenter kan være.

- Denne kraft medfører nye sikkerhedsrisici, når agenter behandler ikke‑pålideligt input.

- Promptinjektion er en nøgletrussel mod AI-agenter — endnu farligere end for chatbots.

- Vedvarende hukommelse kan forstærke fejl og forlænge angreb.

- AI-agenter er kraftfulde, men ikke et sikkert standardvalg for de fleste forbrugere.

Hvad er hypen omkring OpenClaw?

OpenClaw får opmærksomhed, fordi det markerer et skifte fra AI, der svarer på spørgsmål, til AI, der aktivt kan udføre opgaver på et rigtigt system og endda bruge software. De potentielle sikkerhedsproblemer har også betydet, at flere i IT‑sikkerhedskredse taler om OpenClaw. Hvad gør OpenClaw attraktivt for udviklere og erfarne brugere?

OpenClaw skiller sig ud, fordi det kan foretage reelle handlinger, ikke kun generere tekst eller forslag. I stedet for at fortælle dig hvad du skal gøre, kan det gøre tingene selv. Teknologien kan åbne apps, sende beskeder, flytte filer, køre kommandoer og interagere direkte med systemer på dine vegne.

Netop denne grad af automatisering vækker interesse. Udviklere og kraftbrugere ser systemniveaukontrol som en måde at mindske gentagne opgaver eller automatisere arbejdsgange. Ideen om en AI‑agent, der kan “gøre jobbet” i stedet for blot at assistere fra sidelinjen, er stærk.

Det løfte om praktiske handlingsevner er grunden til, at OpenClaw hurtigt er gået fra nicheprojekt til bredere diskussion.

Hvorfor det betyder noget ud over OpenClaw

OpenClaw giver et synligt eksempel på et bredere skift mod AI-agenter, der rent faktisk handler og ikke kun svarer eller rådgiver.

Spørgsmål om potentiel misbrug bliver uundgåelige, når denne type teknologi vokser. OpenClaw viser, hvor AI er på vej hen. Det gør projektet relevant langt ud over ét enkelt projekt og lægger grunden til fortsatte diskussioner om, hvordan disse agenter bør kontrolleres. Kan man stole på dem?

Hvad er AI-agenter, og hvad adskiller dem fra andre AI-værktøjer?

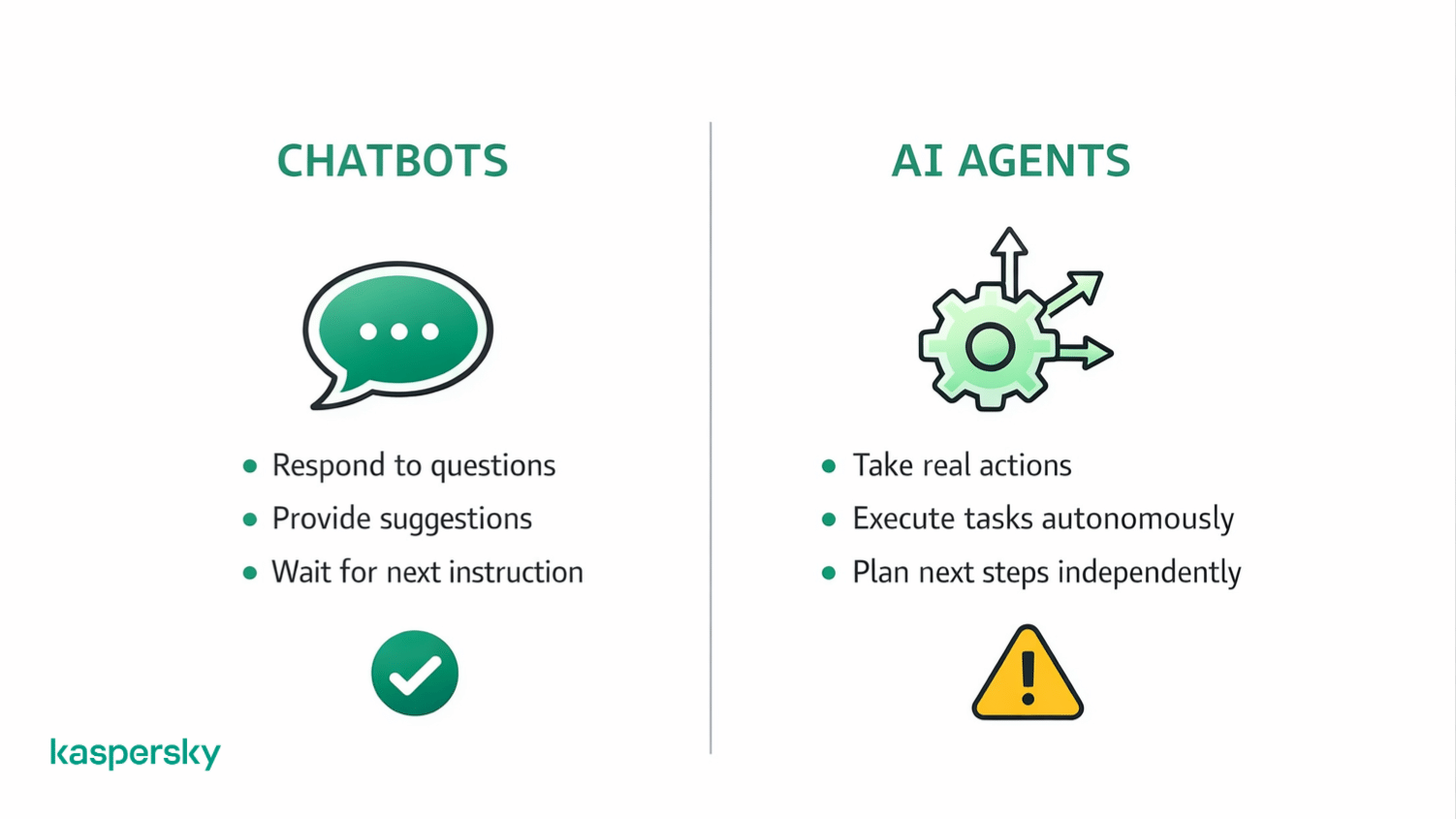

AI-agenter er systemer, der ikke kun giver tekst‑ eller lydsvar på dine spørgsmål. De kan aktivt planlægge handlinger og udføre opgaver for at nå et mål. I stedet for at stoppe ved rådgivning beslutter de, hvad der skal gøres næste, og udfører det.

En AI‑agent kan observere en situation og handle. Det adskiller sig fra de fleste AI‑værktøjer, som reagerer på prompts men venter på næste instruktion. Tidlige eksempler inkluderer opgavekørende agenter som Manus (nu ejet af Meta). Manus demonstrerer, hvordan agenter kan rykke fra chat til handling. Den kan levere dataanalyser eller endda aktivt skrive kode for at løse problemer uden at blive eksplicit bedt om det. Der er mindre menneskelig input.

OpenClaw bygger videre på samme idé om handlingsdygtig AI, men anvender den på en mere direkte og kraftfuld måde.

Er OpenClaw en typisk AI‑agent eller noget mere avanceret?

OpenClaw ligger inden for kategorien AI‑agenter. Det tilbyder en mere kraftfuld implementering end mange af de værktøjer, langt de fleste nu kender til.

Dette AI‑værktøj kan planlægge opgaver og handle uden konstant input. OpenClaw kan interagere direkte med software og operativsystemet, ikke kun med APIs eller begrænsede værktøjer. Den bredere adgang øger nytten og adskiller det fra andre løsninger. Samtidig øger det indsatsen og vigtigheden af sikkerhed.

Hvorfor selvhostede AI-agenter er anderledes

Selvhostede AI-agenter kører lokalt på dit eget system i stedet for på en fjern tjeneste. Det giver brugeren mere kontrol over konfiguration og adfærd. Det skifter også ansvar.

Når en agent har lokal adgang, afhænger sikkerheden af, hvordan den er sat op, hvilke tilladelser den har, og hvordan den overvåges. Mere kontrol medfører også mere risiko.

Nyere projekter viser, hvordan idéen om “selvhostet” AI begynder at ændre sig. For eksempel kan Moltbot (tidligere Clawdbot) nu køres ved hjælp af Cloudflares open source‑værktøj Moltworker. Det fjerner helt behovet for dedikeret lokal hardware ved at køre agenten på en administreret platform i stedet.

Det sænker indgangsbarrieren og forenkler opsætningen, men det flytter også, hvor kontrollen ligger. Når en agent kører på cloud‑infrastruktur, afhænger sikkerheden ikke kun af agenten selv, men også af adgangskontrol og af, hvordan data og tilladelser håndteres på tværs af platformen.

For eksempel kan en bruger forbinde en AI‑agent til sin e‑mail og forvente, at den kun læser beskeder, mens cloud‑opsætningen også tillader at sende e‑mails, medmindre den specifikke tilladelse er slået fra.

Hvordan adskiller AI‑agenter sig fra chatbots som ChatGPT?

Chatbots som ChatGPT svarer, mens AI‑agenter handler.

En chatbot kan give forslag eller forklaringer. En AI‑agent kan aktivt åbne programmer eller gennemføre arbejdsgange.

Som eksempel har nogle mennesker brugt OpenClaw til at automatisere handel. De har udviklet regler og bedt AI om ikke kun at rådgive (det kunne ChatGPT), men faktisk at gennemføre handler.

Hvorfor introducerer AI‑agenter nye sikkerhedsrisici?

Som nævnt tager AI‑agenter handlinger i stedet for kun at give råd. Det indebærer ofte adgang til filer, applikationer eller systemfunktioner.

Den systemadgang og autonomi, der gives til OpenClaw, ændrer både konsekvens og risiko. OpenClaw vil anmode om tilladelse til at interagere med software eller foretage handlinger som at sende en e‑mail eller udfylde formularer uden din løbende overvågning. Det gør den til en usikker faktor.

Fejl eller manipulation kan få reelle konsekvenser. Risikoen er ikke kun, hvad agenten bliver bedt om at gøre, men hvad den tolker som instrukser, mens den udfører en opgave.

Hvorfor upålideligt input er et kerneproblem

AI‑agenter indtager store mængder eksternt indhold (som websider og dokumenter) for at afgøre, hvad de skal gøre næste. Det indhold er ikke altid pålideligt.

Instrukser behøver ikke være direkte. De kan være skjult i tekst eller data, som agenten læser, mens den udfører en opgave. Det gør det muligt for angribere at påvirke en agents adfærd uden nogensinde at interagere med den direkte.

Dette problem åbner en klar vej til promptinjektion. Her bruges upålideligt input til at styre en agent til at udføre handlinger, den aldrig var beregnet til at udføre.

Kraftfulde AI‑værktøjer kræver stærkere beskyttelse

AI‑agenter kan få adgang til filer, e‑mails og systemfunktioner. Kaspersky Premium hjælper med at opdage mistænkelig aktivitet, blokere ondsindede scripts og beskytte dine enheder mod reelle cybertrusler.

Prøv Kaspersky Premium gratisHvad er promptinjektion i AI‑agenter?

Promptinjektion er en måde at manipulere en AI‑agent på ved at fodre den upålideligt indhold, som ændrer dens adfærd.

Risikoen er ikke nødvendigvis en teknisk fejl i koden. Det er, at agenten kan behandle eksternt input som om det var instrukser. Når det sker, kan agenten blive ledt til at udføre handlinger, den aldrig var tænkt til.

Hvordan promptinjektion fungerer i virkelige scenarier

Promptinjektion kan være direkte eller indirekte.

- Direkte – en angriber inkluderer bevidst instrukser i indhold, agenten læser.

- Indirekte – agenten opfanger skjulte eller uventede instrukser fra en hjemmeside eller besked, den behandler som led i normale opgaver.

Nøglespørgsmålet er adfærd. Agenten kan følge det, den tolker som vejledning, selvom vejledningen kom fra upålidelige kilder. Der behøves ikke en softwarefejl for, at dette kan ske.

Hvorfor promptinjektion er farligere for AI‑agenter end for chatbots

Injicerede instrukser påvirker normalt svar og rådgivning fra chatbots. Med AI‑agenter kan de påvirke handlinger.

Hvis en agent har adgang til filer eller systemkontroller, kan manipulerede instrukser føre til ændringer i den virkelige verden. Derfor udgør promptinjektion en større risiko for agenter. Den samme teknik, der ændrer tekstoutput i en chatbot, kan udløse utilsigtede handlinger, når en agent er involveret.

Hvad er vedvarende hukommelse i AI‑agenter?

Vedvarende hukommelse gør det muligt for en AI‑agent at bevare information over tid. Det betyder, at den kan bruge tidligere input til at guide fremtidige beslutninger i stedet for at starte forfra ved hver opgave.

Hvad vedvarende hukommelse betyder for AI‑agenter

En AI‑agent kan gemme kontekst og instruktioner på tværs af sessioner og udvikle foretrukne “adfærdsmønstre”. Det hjælper agenten med at arbejde mere effektivt ved at huske, hvad den har lært eller gjort tidligere.

Det betyder også, at tidligere input kan påvirke senere adfærd. Instrukser eller antagelser, der blev optaget i en tidligere opgave, kan stadig forme, hvordan agenten handler i en anden situation, selv om brugeren ikke længere er bevidst om dem.

Hvorfor vedvarende hukommelse øger sikkerhedsrisici

Vedvarende hukommelse kan introducere forsinkede effekter. En skadelig instruktion forårsager måske ikke umiddelbare problemer, men kan dukke op senere, når betingelserne ligger til rette.

Det gør oprydning sværere. Den gemte adfærd kan gentage sig på tværs af opgaver. At genskabe en agent fuldstændigt kræver ofte at rydde hukommelsen eller genopbygge konfigurationer for at sikre, at uønsket påvirkning er fjernet.

Hvad sker der, hvis en AI‑agent er fejlagtigt konfigureret eller udsat?

En AI‑agent kan blive tilgået eller påvirket på måder, ejeren aldrig har ment, hvilket kan forvandle et nyttigt værktøj til en potentiel sikkerhedsrisiko.

Det kan ske ved en fejl eller misforståelse. Det kan også ske, hvis tredjeparter forsøger at manipulere agenten.

Hvordan AI‑agenter kan blive udsat utilsigtet

Udsættelse sker ofte gennem simple fejl. Noget så simpelt som svag autentificering eller alt for brede tilladelser kan gøre en agent tilgængelig udefra dens tiltænkte miljø.

At køre en agent lokalt gør den ikke automatisk sikker. Hvis den forbinder til internettet eller interagerer med andre systemer, kan den blive påvirket. Lokal kontrol reducerer nogle af risiciene.

Hvorfor udsatte AI‑agenter bliver angrebsflader

Når først en agent er udsat, bliver den noget, angribere kan undersøge, teste og manipulere. De kan forsøge at fodre den med specialfremstilet input, udløse handlinger eller lære, hvordan den opfører sig over tid.

Fordi agenter kan udføre reelle handlinger, behøver misbrug ikke ligne et traditionelt hack. Misbrug kan bestå i at styre adfærd, udtrække data eller forårsage utilsigtede systemændringer — alt sammen uden at udnytte en klassisk softwarefejl.

Hvad er den "dødelige treenighed" inden for AI‑agentsikkerhed?

Den "dødelige treenighed" beskriver tre betingelser, som tilsammen skaber alvorlig sikkerhedsrisiko for AI‑agenter.

De tre betingelser, der muliggør alvorlige angreb

- Den første betingelse er adgang til følsomme data, såsom filer, legitimationsoplysninger eller intern information.

- Den anden er upålideligt input, hvor agenten indtager indhold, den ikke fuldt ud kan verificere.

- Den tredje er evnen til at foretage eksterne handlinger, som at sende forespørgsler, ændre systemer eller køre kommandoer.

Hver for sig kan disse faktorer være håndterbare. De bliver farlige, når de danner denne treenighed. En agent, der læser upålideligt input og kan handle på det, skaber en tydelig vej for manipulation. At kontrollere, hvilke handlinger en agent må udføre, er afgørende.

Bør almindelige brugere køre AI‑agenter i dag?

For de fleste mennesker er AI‑agenter stadig eksperimentelle værktøjer. De kan være nyttige i den rette opsætning. Ulempen? De introducerer også nye risici, som ikke altid er åbenlyse.

Hvornår det kan give mening at bruge en AI‑agent

En AI‑agent kan give mening i kontrollerede og lavrisiko‑scenarier. Det kan være eksperimenter på en separat enhed. Nogle mennesker prøver at køre agenter, der kun håndterer ikke‑følsomme opgaver som at organisere filer eller teste arbejdsgange.

Lad os sige, at du vil bruge agenten til at lave en rejseplan for din kommende tur. Den kan få adgang til de nødvendige oplysninger for at gøre det og blive begrænset i at kontakte personer direkte eller foretage andre skadelige handlinger.

Hvis du er tryg ved at håndtere indstillinger, og fejl ikke får store konsekvenser, kan en agent være et læringsværktøj. Nøglen er at holde omfanget smallt og adgang stramt begrænset.

Hvornår AI‑agenter er en dårlig idé

AI‑agenter er et dårligt valg, når de får adgang til følsomme data eller vigtige konti. At køre agenter uden at forstå tilladelser eller farer ved eksterne input øger hurtigt risikoen.

Det er også helt legitimt at fravælge dem. At vælge ikke at køre en AI‑agent i dag er en rimelig beslutning, hvis bekvemmelighed kommer på bekostning af sikkerhed eller sindsro.

Hvilke grundlæggende sikkerhedsforanstaltninger er vigtige, når man bruger AI‑agenter?

Grundlæggende beskyttelse hjælper med at mindske risiko og forhindre, at fejl bliver alvorlige problemer.

Kasperskys software kan tilføje et ekstra lag beskyttelse ved at markere mistænkelig adfærd og hjælpe med at beskytte konti mod brud. Vores planer blokerer alt fra malware og virusser til ransomware og spionapps.

Hvilke sikkerhedsforanstaltninger betyder mest

Isolation er nøglen. Kør agenter på separate enheder og konti, når det er muligt, så de ikke kan påvirke vigtige data eller systemer. Begræns tilladelser til kun det, agenten reelt behøver. Vi anbefaler, at du undgår at give fuld system‑ eller konto‑adgang som standard.

Godkendelsestrin er også vigtige. Kræv bekræftelse, før følsomme handlinger udføres — det skaber et ophold, som kan forhindre utilsigtet adfærd som fx at bruge penge på dine vegne. Disse simple kontroller har stor effekt uden at gøre tingene unødigt komplicerede.

Hvad betyder AI‑agenter for forbrugernes fremtid med AI?

AI‑agenter peger mod en fremtid, hvor AI‑værktøjer gør mere end at hjælpe — de handler. Men den ændring kommer med afvejninger, som forbrugerne kun lige er begyndt at navigere i.

Hvad dette øjeblik fortæller os om modenheden af AI‑agenter

AI‑agenter er kraftfulde, men umodne. De kan automatisere opgaver, men har stadig udfordringer med dømmekraft og sikkerhed. Det betyder ikke, at agenter ikke vil blive mere sikre eller pålidelige; det betyder, at forventningerne skal forblive realistiske.

AI‑agenter viser, hvor udviklingen bevæger sig hen, men udbredt hverdagbrug vil kræve bedre sikkerhedsforanstaltninger og værktøjer, der er designet med sikkerhed for øje fra starten.

Relaterede artikler:

- Hvordan adresserer ChatGPT cybersikkerhedsbekymringer og potentielle risici?

- Hvad er risikoen ved AI‑cyberkriminalitet i dagens digitale landskab?

- Hvordan forbedrer AI og maskinlæring cybersikkerhedsforanstaltninger?

- Hvad er farerne ved deepfake‑teknologi i dag?

Anbefalede produkter:

FAQs

Er OpenClaw gratis at downloade?

OpenClaw kan downloades gratis på GitHub. Det er open source‑software. Det betyder, at folk kan ændre og distribuere softwaren frit.

Er OpenClaw nemt at sætte op?

Der findes vejledninger, som hurtigt kan få folk i gang med at køre bots, men en mere avanceret opsætning kræver tid og særlig ekspertise. Det er netop derfor risikabelt at køre software, der muligvis ikke er sat korrekt op.